近年来,随着互联网的迅猛发展,信息交流变得更加便捷,但与此同时也带来了新的挑战。未成年人在互联网上的使用不可避免地面临着诸多不良信息和网络犯罪的威胁,而保障青少年安全上网、减少虚假、有害信息对其身心的侵害成为全社会亟待解决的问题。最近是暑期,互联网平台格外注重未成年保护、打造清朗的网络环境。 作为深受年轻人喜爱的新型开放式社交平台,Soul始终将未成年人保护作为核心工作之一,以创新的举措守护青少年社交空间。针对未成年人在平台上可能遭遇的不良信息和网络犯罪,Soul CEO张璐及其团队积极构建了一套严格的保护机制,致力于为青少年提供更安全、健康的社交环境。

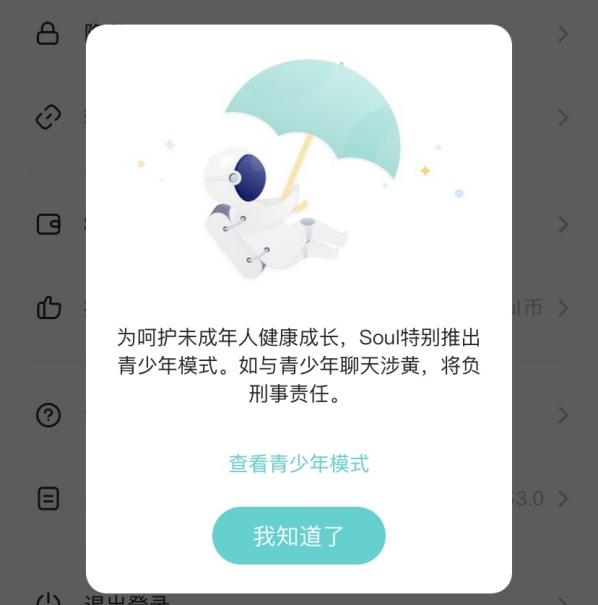

设立青少年模式进行区分 据了解,目前,Soul平台上的未成年用户为过往的存量用户,占比极低。Soul CEO张璐团队一直致力于保障用户的社交体验,特别是对未成年用户的保护非常重视。通过严格的注册年龄限制,Soul要求18周岁以下用户不能注册,确保未成年人无法进入成年模式。新注册用户初入平台需要进行实名认证,若确认用户为未成年人,则无法进入成年模式,从而有效隔离青少年和成年用户的使用体验。

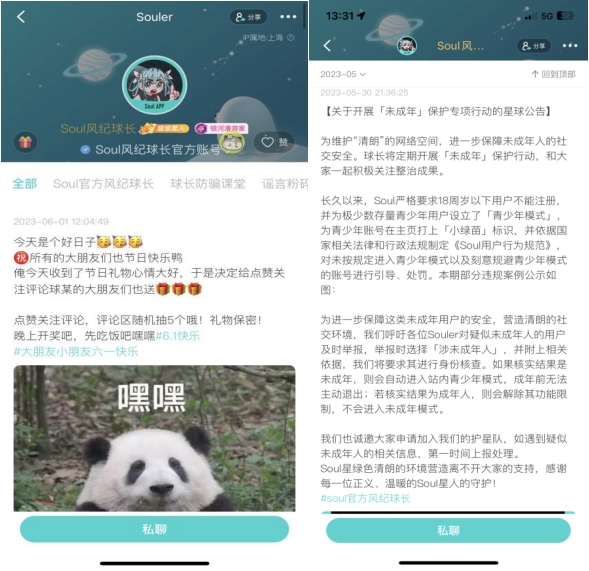

建立严格的审核筛查制度 Soul平台采取多种举措,通过内容识别、设备识别、用户举报等方式加强未成年人的巡检和识别。在内容识别方面,Soul依托自身技术能力打造了未成年内容识别模型,针对公域场景下用户发布的文字、语音、图片等内容进行年龄特征识别,并结合人工判定对未成年人进行精准识别。同时,在一对多场景中,对潜在的未成年用户进行兜底识别,确保高效且准确。 此外,Soul建立并完善了用户举报机制,用户可以通过举报渠道监督和举报假成年人。平台的站内官方账号——Soul官方风纪球长,定期公示【未成年人保护专项】的治理成果,积极保护未成年用户的安全。同时,Soul还采取智能巡检和人工巡检相结合的方式,寻找疑似未成年人的相关信息,并引导其进行实名认证。举报和巡检发现的疑似未成年用户将被限制相关功能的使用,并强制要求进行实名认证。根据认证结果,未成年用户会自动进入青少年模式,而成年用户则解除功能限制,不会进入未成年模式。

严格限制未成年用户使用时间 为保障未成年用户的身心健康,Soul CEO张璐及团队对平台上的未成年用户采取严格的使用时间限制。根据青少年模式规则,未成年用户在平台中的每日累计使用时长限制为40分钟,超过限制后将无法继续使用平台。此外,为帮助未成年用户降低对互联网的依赖,Soul要求未成年人用户仅可在规定时间内(8:00~22:00)访问平台,在非规定时间内,平台将锁定页面并弹出提醒文案,鼓励用户休息。 优化青少年模式下交互逻辑 在通过青少年模式将未成年人用户与成年人用户功能、内容隔离的同时,Soul严格把关青少年模式下的内容,不断优化青少年模式内容池,致力于为青少年提供更多优质和正能量内容。在青少年模式下,Soul平台将对优质内容进行固定展示,鼓励未成年用户浏览优质创作内容,引导他们健康社交、知识社交、兴趣社交,成为有理想有抱负的新一代。 携手青年榜样 共建正向社交 为更好地落实未成年人保护措施,Soul CEO张璐团队还计划在平台上定期举办类似“青年联络官”的活动,邀请各行各业有突出特色、正能量的青年榜样,与青少年用户分享他们的故事,展开深度交流,输出正向内容,让青少年成为互联网科技发展的受益者。 同时,Soul平台还将继续挖掘青少年用户中的优质创作者,鼓励他们发布优质、正能量的内容,包括音乐、手工、绘画、国学等,提升用户整体质量。通过这些举措,Soul平台致力于共建正向社交环境,为青少年用户提供更加健康、积极的社交体验。 作为深受年轻人喜爱的社交平台,Soul始终将保护未成年人作为社会责任,通过创新的未成年保护举措,致力于守护青少年社交空间。未来,Soul CEO张璐将带领团队继续加强未成年人保护工作,不断完善内容风控体系和保护机制,为青少年提供更安全、健康的互联网环境,共同铸造社交安全盾,守护青少年的成长之路。 |